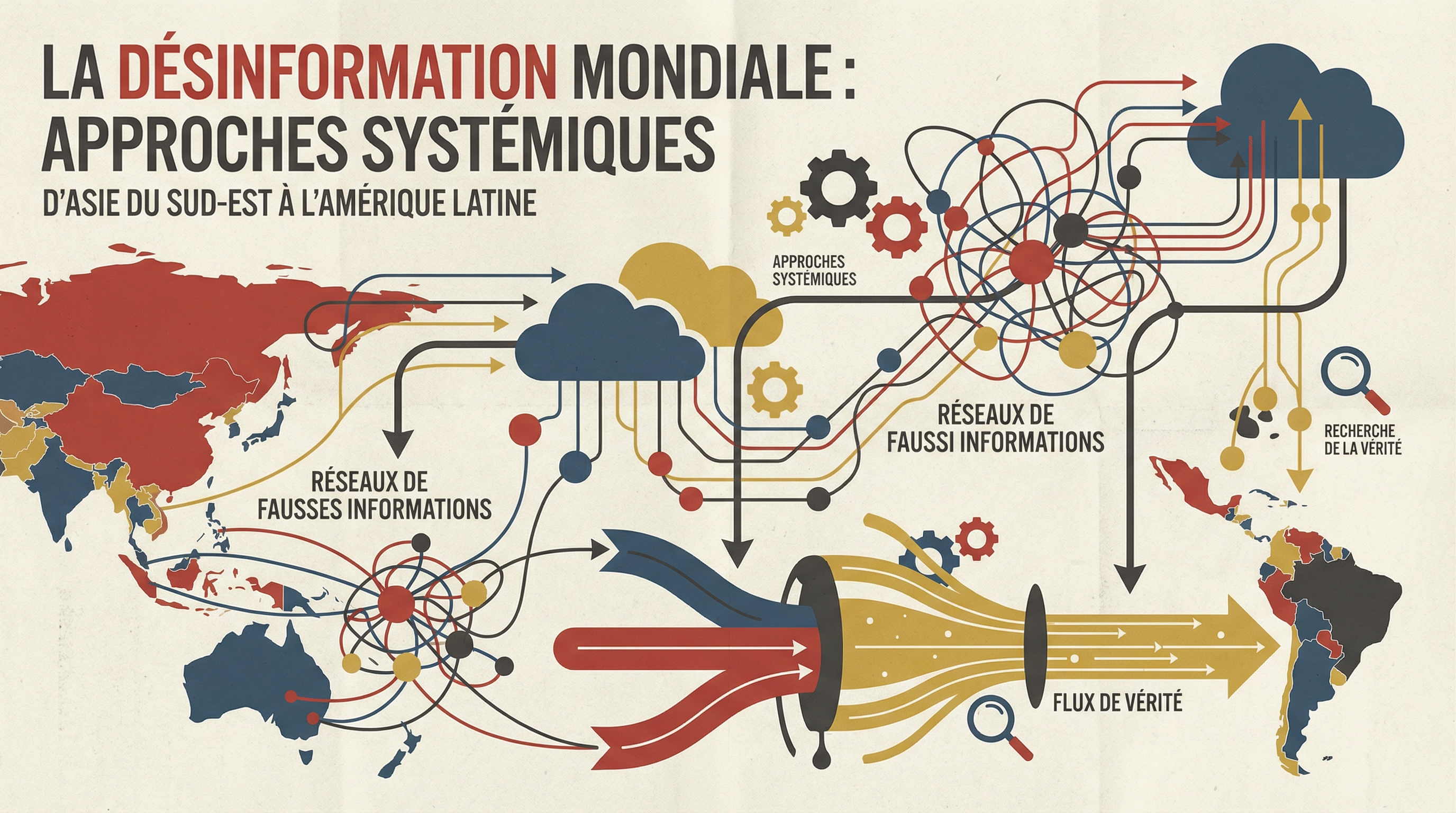

En 2026, 64% des citoyens d'Asie du Sud-Est sont confrontés de manière régulière à la désinformation en ligne [1]. Ce chiffre, issu de rapports régionaux, ne représente qu'une facette d'un phénomène global. Le Forum Économique Mondial identifie la désinformation et la mésinformation comme le deuxième risque mondial le plus sévère sur un horizon de deux ans, et le cinquième sur un horizon de dix ans, juste après les menaces climatiques et la perte de biodiversité [3]. La propagation de contenus faux ou manipulés est devenue une caractéristique structurelle de l'écosystème informationnel numérique, avec un coût économique mondial estimé à 417 milliards de dollars en 2025 par le cabinet Sopra Steria, prenant en compte les pertes de confiance, l'impact sur les marchés financiers et les coûts de la cybersécurité.

Contexte factuel : un écosystème complexe à 3 composantes

La vitesse et l'échelle de la désinformation sont le produit des technologies numériques. Trois mécanismes principaux expliquent sa propagation. Premièrement, les plateformes de médias sociaux et leurs algorithmes. Conçus pour maximiser l'engagement des utilisateurs, ils favorisent les contenus qui suscitent des émotions fortes, qu'ils soient vrais ou faux. Cette architecture de l'attention récompense le sensationnalisme et la polarisation, créant des "chambres d'écho" où les fausses narrations sont amplifiées. Deuxièmement, les applications de messagerie privée chiffrée, comme WhatsApp ou Telegram. Elles permettent la diffusion virale de contenus au sein de groupes fermés et de confiance, rendant la vérification et l'intervention extérieure presque impossibles. Au Brésil et en Inde, WhatsApp a été un vecteur majeur de désinformation politique lors des dernières élections. Troisièmement, l'avènement des technologies d'intelligence artificielle générative. La création de "deepfakes" audio et vidéo et la production de textes quasi-indiscernables d'une production humaine abaissent drastiquement le coût de création de désinformation à grande échelle, permettant des opérations d'influence personnalisées et automatisées. Un deepfake vocal du président américain a ainsi été utilisé en 2024 pour décourager la participation à une élection primaire, illustrant le potentiel de déstabilisation de ces outils.

Les acteurs de cet écosystème sont variés. Des États, comme la Russie ou la Chine, utilisent la désinformation comme une arme de politique étrangère pour semer la discorde dans les démocraties ou comme un outil de contrôle domestique pour réprimer la dissidence. Des groupes politiques l'emploient pour polariser le débat public et mobiliser leur base électorale. Des acteurs économiques créent des "fermes à clics" aux Philippines ou en Macédoine du Nord, employant des travailleurs précaires pour amplifier artificiellement des messages à des fins commerciales ou politiques. Enfin, et c'est une tendance de fond, des citoyens ordinaires, agissant par conviction, relaient des informations fausses. Une étude de l'Université de Georgetown qualifie ce phénomène de "désinformation authentique" [1]. Des pays comme le Brésil, l'Inde, le Nigeria et les Philippines sont devenus des exemples documentés de l'impact de ces stratégies. En Indonésie, des campagnes xénophobes contre les réfugiés Rohingya ont été animées par des "buzzers", des travailleurs de l'influence incluant des mères au foyer et des bénévoles politiques, qui articulaient leur action autour d'une obligation morale de défense de la patrie [1].

Analyse : 3 approches systémiques qui fonctionnent

Face à ce défi, des réponses structurées émergent et démontrent une certaine efficacité. Une étude menée entre 2024 et 2025 par le projet RAIDAR (Researching Asian Information Disorder and Responses) souligne l'importance d'une approche multi-facettes [1]. L'analyse des solutions existantes à travers le monde permet de distinguer trois piliers principaux : la vérification des faits par la société civile, l'éducation aux médias et à l'information des citoyens, et la régulation des plateformes numériques par les pouvoirs publics.

1. Le fact-checking collaboratif : plus de 1000 organisations dans le monde

La vérification des faits, ou fact-checking, constitue la première ligne de défense. Des organisations de la société civile se sont spécialisées dans la vérification des affirmations de personnalités publiques et des contenus viraux. Le réseau international de fact-checking (IFCN), hébergé par l'Institut Poynter, rassemble plus de 100 signataires de son code de principes à travers le monde. Aux Philippines, le média Rappler a initié un modèle collaboratif qui associe des journalistes, des universitaires, des ONG et des bénévoles pour identifier et corriger les fausses informations [6]. Cette pyramide de la vérification permet de traiter un volume important de contenus et de diffuser les corrections à une large audience. En Afrique, l'organisation indépendante Africa Check, fondée en 2012, opère au Nigeria, en Afrique du Sud, au Kenya et au Sénégal, produisant des centaines de rapports de vérification chaque année [7]. En Amérique Latine, des organisations comme Chequeado en Argentine ou Lupa au Brésil jouent un rôle similaire. Ces initiatives augmentent le coût de la désinformation pour ceux qui la propagent et fournissent des informations corrigées au public. Leur impact est cependant limité par la vitesse de propagation des fausses nouvelles, qui dépasse souvent leur capacité de réaction. Le fact-checking intervient souvent a posteriori, une fois que le contenu a déjà atteint une large audience.

2. L'éducation aux médias : le modèle finlandais et les 10 500 créateurs formés par l'UNESCO

La solution la plus durable consiste à renforcer la capacité des citoyens à évaluer l'information. La Finlande a intégré l'éducation aux médias et à l'information (EMI) dans son curriculum national à tous les niveaux, de la maternelle à l'éducation des adultes [8]. Cette politique, initiée en réponse à la propagande russe après 2014, vise à développer la pensée critique et les compétences nécessaires pour naviguer dans un environnement informationnel complexe. Les élèves apprennent à identifier les sources, à reconnaître les techniques de manipulation et à comprendre le modèle économique des plateformes. Les évaluations internationales montrent que la population finlandaise est la mieux préparée en Europe pour résister à la désinformation. S'inspirant de ce succès, l'UNESCO promeut activement l'EMI à l'échelle mondiale. L'organisation a développé un curriculum type pour les enseignants et a formé plus de 10 500 créateurs de contenu et journalistes dans plus de 150 pays pour déployer ces programmes et promouvoir une information de qualité [2]. L'objectif est de créer une immunité collective face à la manipulation de l'information, en agissant sur la demande plutôt que seulement sur l'offre de fausses nouvelles.

3. La régulation des plateformes : 2 lois majeures en Europe et au Brésil

La responsabilité des intermédiaires techniques est un levier d'action de plus en plus utilisé. L'Union Européenne a adopté en 2022 le Digital Services Act (DSA). Cette législation impose aux très grandes plateformes en ligne (plus de 45 millions d'utilisateurs dans l'UE) des obligations strictes [9]. Elles doivent analyser et atténuer les risques systémiques liés à leurs services, y compris la diffusion de désinformation. Le DSA exige une plus grande transparence sur le fonctionnement de leurs algorithmes de recommandation et de modération de contenu, et oblige les plateformes à donner accès à leurs données aux chercheurs agréés. Au Brésil, le projet de loi 2630, surnommé "loi sur les fausses nouvelles", a pour but de réguler les plateformes et les applications de messagerie. Bien que son adoption soit bloquée par un intense lobbying des géants de la technologie, il prévoit des mesures de transparence et de diligence pour les plateformes, et des sanctions en cas de manquement. Ces cadres réglementaires visent à forcer les entreprises technologiques à assumer leur rôle dans la santé de l'écosystème informationnel, en passant d'un modèle d'autorégulation volontaire à des obligations légales contraignantes.

Nuances et limites : les 3 angles morts de la lutte anti-désinformation

Chacune de ces approches rencontre des obstacles importants. Premièrement, l'efficacité du fact-checking se heurte aux biais cognitifs. Des études en psychologie sociale montrent que les individus ont tendance à rejeter les informations qui contredisent leurs croyances préexistantes (biais de confirmation). Le fact-checking est donc moins efficace sur les populations déjà polarisées. Deuxièmement, l'éducation aux médias est une stratégie à long terme. Son déploiement à grande échelle nécessite des investissements financiers et humains considérables, ainsi qu'une volonté politique forte et durable, ce qui fait défaut dans de nombreux pays. Troisièmement, la régulation des plateformes soulève des questions fondamentales sur la liberté d'expression. La définition de la désinformation est complexe et le risque de censure de discours légitimes, mais critiques, est réel. Les plateformes elles-mêmes mettent en avant la difficulté technique de modérer des milliards de contenus chaque jour dans des centaines de langues.

Un défi majeur reste la propagation de la désinformation dans les espaces privés et chiffrés. Les interventions y sont techniquement complexes et posent des problèmes éthiques et de respect de la vie privée. Enfin, l'émergence d'une désinformation portée par des acteurs "authentiques", comme le documente l'étude de l'Université de Georgetown, pose une question nouvelle [1]. Lorsque la désinformation n'est pas le fruit d'une opération clandestine mais l'expression d'une conviction sincère, bien que basée sur des faits erronés, les stratégies de lutte doivent être repensées pour éviter de renforcer le sentiment de persécution chez ces communautés.

Perspective : une course technologique et démocratique

La lutte contre la désinformation ne sera gagnée par aucune solution miracle. Seule une combinaison d'approches, alliant la réactivité du fact-checking, la profondeur de l'éducation et la force de la loi, peut endiguer le phénomène. La transparence des plateformes, que des régulations comme le DSA commencent à imposer, est une condition nécessaire pour permettre une recherche indépendante sur les dynamiques de propagation et l'efficacité des contre-mesures. La collaboration entre les chercheurs, la société civile, les journalistes et les pouvoirs publics est essentielle.

La question centrale pour les années à venir est celle de l'adaptation. Les technologies de l'IA qui permettent de créer de la désinformation peuvent aussi être utilisées pour la détecter. Une course technologique est engagée. Mais au-delà de la technologie, c'est la résilience des institutions démocratiques, la confiance dans les médias professionnels et la capacité des citoyens à s'engager dans un débat public fondé sur des faits qui sont en jeu. La réponse à la crise de la désinformation sera donc autant démocratique que technologique, et elle exigera un investissement continu et coordonné à l'échelle mondiale.

Références

- 1. Georgetown University, Georgetown Journal of International Affairs, "Tackling the Disinformation Ecosystem: System-Based Insights from Southeast Asia", 2026. (https://gjia.georgetown.edu/2026/03/20/tackling-the-disinformation-ecosystem-system-based-insights-from-southeast-asia/)

- 2. UNESCO, "World Trends in Freedom of Expression and Media Development Report 2022-2025", 2026. (https://www.unesco.org/en/articles/new-report-unesco-warns-serious-decline-freedom-expression-and-safety-journalists-worldwide)

- 3. World Economic Forum, "The Global Risks Report 2026", 2026. (https://www.weforum.org/publications/global-risks-report-2026/)

- 4. Carnegie Endowment for International Peace, "Countering Disinformation Effectively: An Evidence-Based Policy Guide", 2024. (https://carnegieendowment.org/research/2024/01/countering-disinformation-effectively-an-evidence-based-policy-guide)

- 5. Oxford Internet Institute, "Disinformation Research". (https://www.oii.ox.ac.uk/news-events/oii_tag/disinformation/)

- 6. Rappler. (https://www.rappler.com/)

- 7. Africa Check. (https://africacheck.org/)

- 8. Finnish Government, "Media literacy in Finland".

- 9. European Commission, "The Digital Services Act". (https://digital-strategy.ec.europa.eu/en/policies/digital-services-act)

- Recevez les analyses du Journal directement dans votre boîte mail.

- Les émissions de CO2 de la Chine ont baissé de 0,3 % en 2025. C'est un chiffre modeste. Mais il prolonge une tendance qui dure depuis 21 mois consécutifs : depuis mars 2024, les émissions du premier pollueur mondial sont "stables ou en baisse".

- L'IA détruit-elle des emplois ? Deux études publiées en mars 2026 — l'une par la Harvard Business School, l'autre par Anthropic — apportent les premières données empiriques solides. Et la réponse est plus nuancée que le débat public ne le laisse croire.

- Le paludisme a tué 608 000 personnes en 2022, dont 95 % en Afrique subsaharienne et 78 % d'enfants de moins de cinq ans. Et pour la première fois, un vaccin déployé à grande échelle montre des résultats mesurables sur le terrain.

- Avoir envie d'avoir 20 ans aujourd'hui. Un média indépendant qui documente le progrès avec rigueur, sans naïveté ni catastrophisme.

- Des fiches de lecture structurées : thèse centrale, arguments clés, limites, et verdict.

- Le JdP est un projet éditorial indépendant fondé sur les données, les contre-narratifs et l'optimisme lucide. Chaque article est sourcé, nuancé et ouvert à la discussion.

- Le Journal d'un Progressiste utilise des cookies pour améliorer l'expérience de lecture et comprendre comment le site est utilisé. Aucune donnée n'est collectée à des fins commerciales, publicitaires ou de revente. Les cookies nécessaires au fonctionnement du site sont toujours actifs. Les cookies optionnels ne sont activés qu'avec votre consentement explicite, conformément au RGPD.