Longtemps cantonnée aux publications académiques et aux expériences de physique fondamentale, l'informatique quantique commence à produire ses premiers résultats concrets. En 2026, une compétition intense entre géants de la technologie, startups spécialisées et puissances étatiques a permis des avancées significatives dans la conception de processeurs et la mise en œuvre d'algorithmes. Si l'ordinateur quantique universel et tolérant aux pannes demeure un objectif lointain, les machines actuelles, bien qu'imparfaites, trouvent déjà des applications dans des secteurs aussi variés que la pharmacie, la finance et la science des matériaux, signalant une transition progressive de la recherche fondamentale vers l'ingénierie appliquée.

La course aux qubits : des approches technologiques en compétition

La construction d'un ordinateur quantique repose sur la capacité à créer et manipuler des bits quantiques, ou qubits. Contrairement au bit classique qui ne peut prendre que la valeur 0 ou 1, le qubit peut exister dans une superposition de ces deux états simultanément. Cette propriété, combinée à l'intrication qui lie le destin de plusieurs qubits de manière non locale, est à l'origine de la puissance de calcul exponentielle promise par le quantique. Plusieurs technologies s'affrontent pour construire les qubits les plus performants, chacune avec ses propres forces et faiblesses.

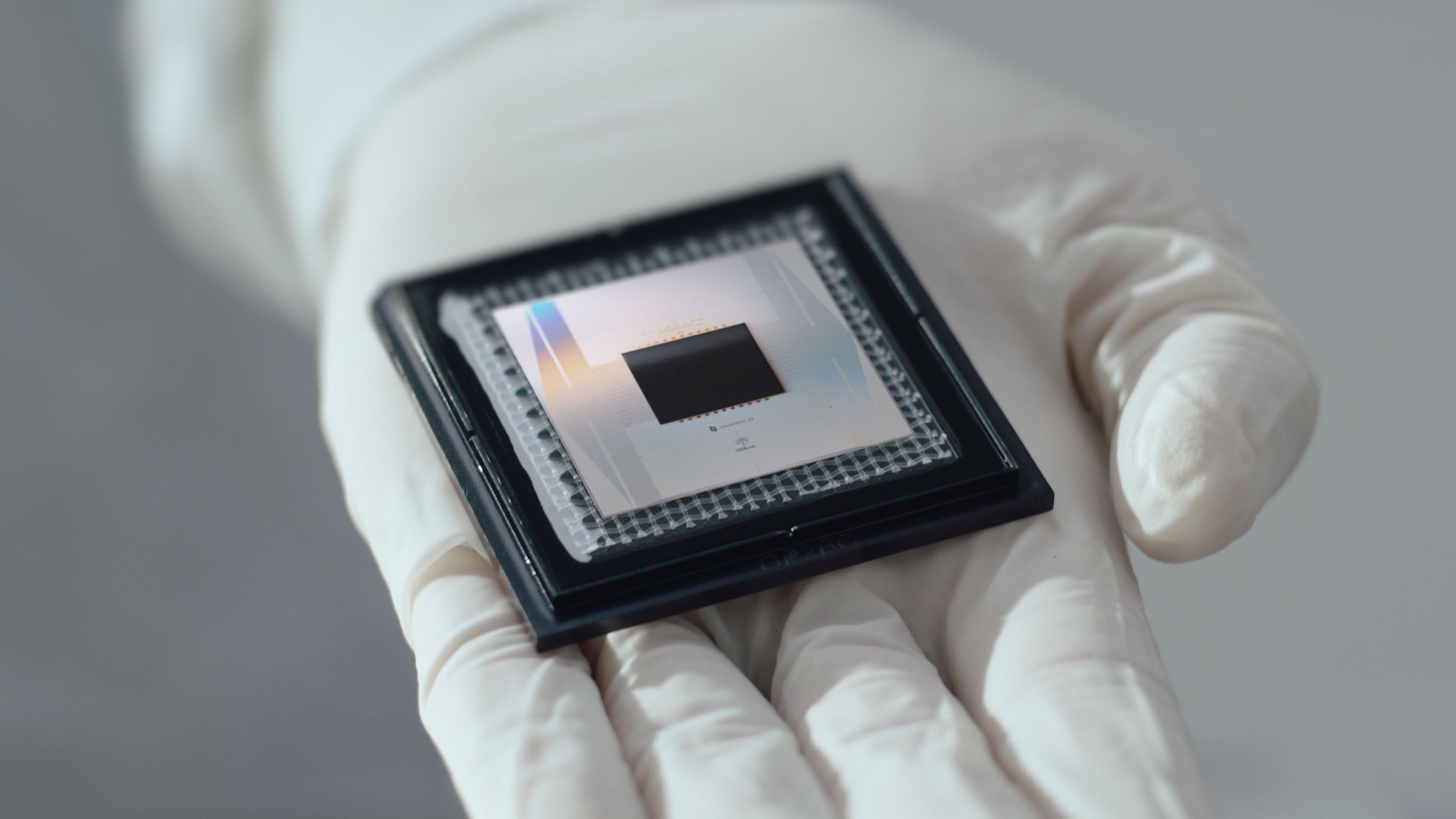

Les processeurs supraconducteurs, adoptés par des acteurs comme Google, IBM et Rigetti, sont actuellement les plus répandus. Ils consistent en de minuscules circuits en niobium ou en aluminium refroidis à des températures proches du zéro absolu (autour de 15 millikelvins) pour que le matériau devienne supraconducteur et minimise les perturbations électriques. Cette technologie permet des vitesses de calcul élevées, avec des opérations de porte se mesurant en nanosecondes, mais la sensibilité des qubits à leur environnement (le "bruit" thermique, les vibrations, les champs électromagnétiques) reste un obstacle majeur. Google a affirmé sa position avec son processeur Willow, démontrant une capacité de calcul dépassant celle des supercalculateurs classiques pour une tâche spécifique [1]. L'entreprise a notamment utilisé Willow pour implémenter un code de surface, une méthode de correction d'erreurs quantiques, avec 105 qubits, atteignant un taux d'erreur logique de 0,143 % par cycle [2]. De son côté, IBM poursuit une feuille de route agressive, avec le processeur Condor de 1 121 qubits et le Heron de 133 qubits, ce dernier offrant une réduction d'erreur significative grâce à une nouvelle architecture de coupleurs [3].

Une autre approche mature est celle des ions piégés, défendue par des entreprises comme IonQ et Honeywell (maintenant Quantinuum). Ici, des atomes, comme l'ytterbium, sont ionisés (on leur retire un électron) et suspendus dans un champ électromagnétique sous vide. Des lasers sont ensuite utilisés pour refroidir les ions et manipuler leur état quantique. Cette méthode offre une excellente stabilité et une grande fidélité des qubits, qui sont presque parfaitement identiques et bien isolés de l'environnement. Les opérations sont cependant plus lentes que sur les puces supraconductrices (de l'ordre de la microseconde). Le système Forte d'IonQ, avec ses 36 qubits, affiche des taux d'erreur de porte très faibles, ce qui est un avantage pour l'exécution d'algorithmes complexes [4].

La photonique, qui utilise les particules de lumière (photons) comme qubits, représente une troisième voie prometteuse. PsiQuantum est le porte-drapeau de cette technologie, avec l'objectif extrêmement ambitieux de construire un ordinateur tolérant aux pannes d'un million de qubits d'ici 2027 [6]. L'avantage potentiel de la photonique est sa capacité à fonctionner à température ambiante et à s'appuyer sur les infrastructures de fabrication de l'industrie des semi-conducteurs. Cependant, faire interagir les photons de manière contrôlée pour créer des portes logiques à deux qubits est une difficulté technique considérable, car les photons interagissent très peu entre eux.

Des applications industrielles qui se dessinent

L'effervescence technologique autour du quantique commence à se traduire par des cas d'usage concrets, en particulier dans les industries où la simulation de systèmes complexes est une nécessité. Le secteur pharmaceutique est l'un des plus prometteurs. La conception de nouveaux médicaments repose sur la compréhension fine des interactions moléculaires, un problème de simulation qui dépasse rapidement les capacités des ordinateurs classiques. Des entreprises comme AstraZeneca, Boehringer Ingelheim et Amgen explorent l'utilisation d'algorithmes quantiques pour simuler le comportement de molécules complexes, comme des protéines, afin de prédire leur affinité avec une cible thérapeutique [8]. La simulation précise de la dynamique moléculaire pourrait réduire considérablement le temps et le coût de développement de nouveaux médicaments, qui se chiffre actuellement en milliards de dollars et peut prendre plus d'une décennie.

La finance est un autre domaine où l'optimisation est reine. La gestion de portefeuille, l'évaluation des risques et la tarification des produits dérivés sont autant de problèmes qui pourraient bénéficier de la puissance de calcul quantique. HSBC a rapporté une amélioration de 34 % dans la prédiction des transactions obligataires en utilisant des modèles d'apprentissage automatique améliorés par le quantique [9]. De même, le gestionnaire d'actifs Vanguard a collaboré avec IBM pour utiliser le processeur Heron dans des tâches d'optimisation de portefeuille, démontrant le potentiel de ces nouvelles machines pour des problèmes financiers à grande échelle [9]. Au-delà de l'optimisation, les algorithmes quantiques pourraient accélérer les simulations de Monte Carlo, utilisées massivement pour l'évaluation des risques et la tarification d'options complexes.

En science des matériaux, les ordinateurs quantiques sont employés pour analyser la configuration des atomes et des molécules. Ces simulations permettent de prédire les propriétés de nouveaux matériaux. Des recherches ont par exemple porté sur le calcul de l'énergie de structures de graphène défectueuses, une information utile pour la conception de nouveaux composants électroniques [10]. La capacité à concevoir in silico des matériaux avec des propriétés spécifiques pourrait avoir des retombées dans des domaines aussi variés que l'énergie, avec le développement de meilleurs catalyseurs pour la production d'hydrogène vert ou de batteries plus performantes, et l'aéronautique, avec la création d'alliages plus légers et plus résistants.

Une compétition géopolitique et financière intense

La promesse d'une rupture technologique majeure a déclenché une course aux investissements à l'échelle mondiale. Les gouvernements, conscients des implications stratégiques de l'informatique quantique, déploient des plans nationaux dotés de budgets considérables. La Chine mène cette course avec des investissements publics estimés à plus de 15 milliards de dollars, dont une part significative est allouée à son Laboratoire national des sciences de l'information quantique [11]. Cette stratégie volontariste se manifeste également dans le domaine spatial, avec le satellite Micius dédié aux communications quantiques, et sur le plan industriel, avec des acteurs comme Origin Quantum qui a développé un ordinateur supraconducteur de 72 qubits et déposé plus de 200 brevets [7]. L'objectif affiché est de parvenir à une autonomie technologique complète dans ce secteur jugé souverain.

Face à cette offensive, les États-Unis et l'Europe ne sont pas en reste. Le National Quantum Initiative Act américain, lancé en 2018, a mobilisé des milliards de dollars pour la recherche et le développement, en coordonnant les efforts des agences fédérales (DOE, NSF, NIST), des universités et de l'industrie. En France, le plan quantique national, annoncé en 2021, est doté de 1,8 milliard d'euros sur cinq ans, avec pour objectif de financer la recherche fondamentale, le développement de prototypes et la création d'un écosystème industriel complet, de la fabrication des composants aux logiciels [1]. Des initiatives similaires existent en Allemagne (2 milliards d'euros), au Royaume-Uni et aux Pays-Bas, créant un paysage de compétition mais aussi de collaboration au sein du bloc occidental.

Cette dynamique d'investissement public est complétée par un afflux de capitaux privés. Les géants de la technologie (Google, IBM, Microsoft, Amazon) investissent massivement en interne, tandis que les fonds de capital-risque financent un écosystème de startups dynamiques comme PsiQuantum, Rigetti ou Quantinuum. Cette double source de financement accélère le rythme des innovations et la transition des découvertes de laboratoire vers des produits commercialisables. L'enjeu est de taille : la première nation ou entreprise qui maîtrisera l'informatique quantique à grande échelle disposera d'un avantage considérable dans de nombreux domaines, de la sécurité nationale, avec la menace que fait peser l'algorithme de Shor sur la cryptographie actuelle, à la compétitivité économique.

Les verrous technologiques et scientifiques à lever

Malgré les progrès indéniables, la route vers l'ordinateur quantique universel est encore longue et semée d'embûches. Le principal obstacle demeure la décohérence, un phénomène par lequel les qubits perdent leur état quantique au contact de leur environnement, ce qui entraîne des erreurs de calcul. La correction d'erreurs quantiques, qui consiste à utiliser plusieurs qubits physiques pour coder un seul qubit logique plus robuste, est une voie de recherche active mais gourmande en ressources. On estime qu'il faudra des milliers, voire des millions de qubits physiques pour créer un seul qubit logique suffisamment fiable pour des calculs complexes.

Les machines actuelles, qualifiées de "bruyantes" (Noisy Intermediate-Scale Quantum ou NISQ), sont limitées en nombre de qubits et en fidélité. Elles ne peuvent exécuter que des algorithmes de faible profondeur et sont incapables de factoriser de grands nombres, l'application qui a initialement fait la renommée du quantique avec l'algorithme de Shor. Néanmoins, ces machines NISQ se révèlent utiles pour des problèmes d'optimisation et de simulation où une solution approchée est acceptable. La recherche se concentre sur le développement d'algorithmes spécifiquement conçus pour tirer parti de ces machines imparfaites.

L'écosystème logiciel commence également à se structurer, avec le développement de langages de programmation (comme Qiskit d'IBM ou Cirq de Google) et de compilateurs qui permettent aux développeurs d'abstraire la complexité du matériel quantique. Des plateformes cloud comme IBM Quantum Experience ou Amazon Braket démocratisent l'accès à ces technologies et favorisent l'émergence d'une communauté de chercheurs et d'ingénieurs. Le développement des talents est d'ailleurs un aspect fondamental de cette nouvelle industrie, qui nécessitera des compétences pointues à l'intersection de la physique, de l'informatique et de l'ingénierie. Les universités et les entreprises mettent en place des programmes de formation pour préparer la main-d'œuvre de demain à cette transition annoncée.

La menace que l'informatique quantique fait peser sur la cryptographie actuelle est prise très au sérieux. L'algorithme de Shor, s'il était exécuté sur une machine suffisamment puissante, pourrait casser les systèmes de chiffrement RSA et ECC qui protègent aujourd'hui la quasi-totalité des communications numériques, des transactions bancaires aux secrets d'État. Cette perspective a poussé le NIST (National Institute of Standards and Technology) américain à finaliser en 2024 ses premiers standards de cryptographie post-quantique, après huit ans de travail. Trois algorithmes ont été retenus : ML-KEM (anciennement CRYSTALS-Kyber) pour l'échange de clés, et ML-DSA (CRYSTALS-Dilithium) et SLH-DSA (SPHINCS+) pour les signatures numériques. La migration vers ces nouveaux standards est un chantier considérable pour les entreprises et les administrations, car elle implique de mettre à jour des milliards d'appareils et de protocoles. Le risque dit "harvest now, decrypt later" — où des acteurs malveillants stockent aujourd'hui des données chiffrées pour les décrypter plus tard avec un ordinateur quantique — rend cette transition urgente, même si l'ordinateur quantique capable de casser RSA-2048 n'existe pas encore.

En 2026, l'informatique quantique a définitivement quitté le domaine de la pure spéculation. La convergence des investissements massifs, des avancées matérielles et de l'émergence de cas d'usage concrets dessine les contours d'une nouvelle ère informatique. Si les applications les plus ambitieuses tardent à se concrétiser, la dynamique enclenchée est suffisamment puissante pour transformer en profondeur des pans entiers de la science et de l'industrie dans la décennie à venir. La question n'est plus de savoir si l'ordinateur quantique verra le jour, mais plutôt quand et sous quelle forme il atteindra une maturité suffisante pour bouleverser notre monde.

Références

- [1] Tech Insider. L'informatique quantique en 2026, tech-insider.org

- [2] Nature. Google Willow quantum error correction, nature.com

- [3] IBM Newsroom. IBM Debuts Next-Generation Quantum Processor, newsroom.ibm.com

- [4] IonQ. Forte Quantum System, ionq.com

- [5] Rigetti. Multi-chip quantum computer, rigetti.com

- [6] IEEE Spectrum. PsiQuantum supercomputer, spectrum.ieee.org

- [7] Origin Quantum. originqc.com.cn

- [8] McKinsey. The quantum revolution in pharma, mckinsey.com

- [9] IBM. Quantum computing shows potential in finance, ibm.com

- [10] AIP. Quantum computing and materials science, pubs.aip.org

- [11] PatentPC. Government spending on quantum computing, patentpc.com

- Recevez les analyses du Journal directement dans votre boîte mail.

- Les émissions de CO2 de la Chine ont baissé de 0,3 % en 2025. C'est un chiffre modeste. Mais il prolonge une tendance qui dure depuis 21 mois consécutifs : depuis mars 2024, les émissions du premier pollueur mondial sont "stables ou en baisse".

- L'IA détruit-elle des emplois ? Deux études publiées en mars 2026 — l'une par la Harvard Business School, l'autre par Anthropic — apportent les premières données empiriques solides. Et la réponse est plus nuancée que le débat public ne le laisse croire.

- Le paludisme a tué 608 000 personnes en 2022, dont 95 % en Afrique subsaharienne et 78 % d'enfants de moins de cinq ans. Et pour la première fois, un vaccin déployé à grande échelle montre des résultats mesurables sur le terrain.

- Avoir envie d'avoir 20 ans aujourd'hui. Un média indépendant qui documente le progrès avec rigueur, sans naïveté ni catastrophisme.

- Des fiches de lecture structurées : thèse centrale, arguments clés, limites, et verdict.

- Le JdP est un projet éditorial indépendant fondé sur les données, les contre-narratifs et l'optimisme lucide. Chaque article est sourcé, nuancé et ouvert à la discussion.

- Le Journal d'un Progressiste utilise des cookies pour améliorer l'expérience de lecture et comprendre comment le site est utilisé. Aucune donnée n'est collectée à des fins commerciales, publicitaires ou de revente. Les cookies nécessaires au fonctionnement du site sont toujours actifs. Les cookies optionnels ne sont activés qu'avec votre consentement explicite, conformément au RGPD.